وزارة الصحة الأمريكية تكشف عن استراتيجية لتوسيع نطاق اعتمادها لتكنولوجيا الذكاء الاصطناعي

نيويورك (AP) – حددت وزارة الصحة والخدمات الإنسانية الأمريكية يوم الخميس استراتيجية لتوسيع استخدامها للذكاء الاصطناعي، بناءً على احتضان إدارة ترامب المتحمس للتكنولوجيا سريعة التقدم مع إثارة تساؤلات حول كيفية حماية المعلومات الصحية.

ووصفت وزارة الصحة والخدمات الإنسانية الخطة بأنها "خطوة أولى" تركز إلى حد كبير على جعل عملها أكثر كفاءة وتنسيق اعتماد الذكاء الاصطناعي عبر الأقسام. لكن الوثيقة المكونة من 20 صفحة أثارت أيضًا بعض الخطط الأكبر لتعزيز ابتكار الذكاء الاصطناعي، بما في ذلك تحليل بيانات صحة المرضى وتطوير الأدوية.

"لفترة طويلة جدًا، ظلت إدارتنا غارقة في البيروقراطية والعمل المزدحم"، كما كتب نائب وزير الصحة والخدمات الإنسانية جيم أونيل في مقدمة الاستراتيجية. "لقد حان الوقت لإزالة هذه الحواجز التي تحول دون التقدم والتوحد في استخدامنا للتكنولوجيا لجعل أمريكا صحية مرة أخرى."

تشير الإستراتيجية الجديدة إلى كيفية تبني القادة عبر إدارة ترامب لابتكار الذكاء الاصطناعي، وتشجيع الموظفين عبر القوى العاملة الفيدرالية على استخدام روبوتات الدردشة ومساعدي الذكاء الاصطناعي في مهامهم اليومية. مع تحقيق تكنولوجيا الذكاء الاصطناعي التوليدي قفزات كبيرة في ظل إدارة الرئيس جو بايدن، أصدر أمرًا تنفيذيًا لإنشاء حواجز حماية لاستخدامها. ولكن عندما تولى الرئيس دونالد ترامب منصبه، ألغى هذا الأمر وسعت إدارته إلى إزالة الحواجز التي تحول دون استخدام الذكاء الاصطناعي في جميع أنحاء الحكومة الفيدرالية.

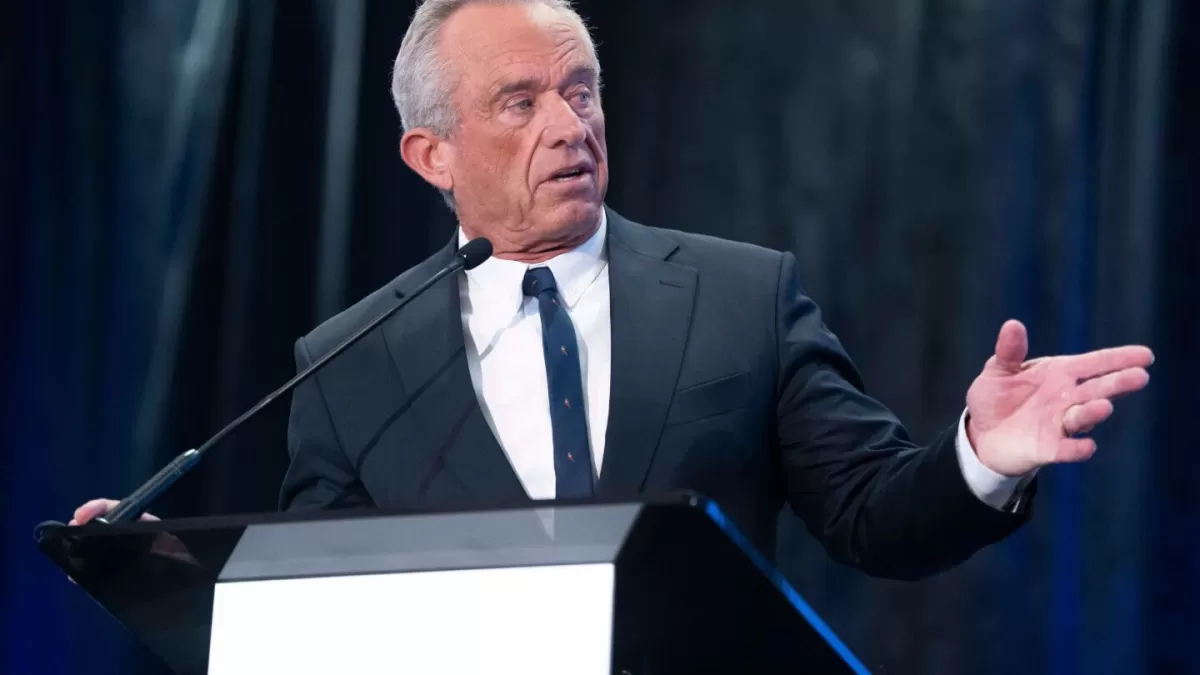

وقال الخبراء إن رغبة الإدارة في تحديث العمليات الحكومية تمثل فرصًا ومخاطر في نفس الوقت. قال البعض إن ابتكار الذكاء الاصطناعي داخل وزارة الصحة والخدمات الإنسانية يتطلب معايير صارمة لأنها كانت تتعامل مع بيانات حساسة وتساءلوا عما إذا كان سيتم تلبية هذه المعايير تحت قيادة وزير الصحة روبرت إف كينيدي جونيور. كما أعرب البعض في حركة "اجعل أمريكا صحية مرة أخرى" الخاصة بكينيدي عن مخاوفهم بشأن قدرة شركات التكنولوجيا على الوصول إلى المعلومات الشخصية للأشخاص.

تشجع الإستراتيجية استخدام الذكاء الاصطناعي في جميع أنحاء القسم

تدعو خطة HHS الجديدة إلى تبني ثقافة "المحاولة أولاً" لمساعدة الموظفين على أن يصبحوا أكثر إنتاجية وقدرة من خلال استخدام الذكاء الاصطناعي. في وقت سابق من هذا العام، أتاحت وزارة الصحة والخدمات الإنسانية نموذج الذكاء الاصطناعي الشهير ChatGPT لكل موظف في القسم.

تحدد الوثيقة خمس ركائز أساسية لاستراتيجية الذكاء الاصطناعي الخاصة بها للمضي قدمًا، بما في ذلك إنشاء هيكل حوكمة يدير المخاطر، وتصميم مجموعة من موارد الذكاء الاصطناعي للاستخدام عبر القسم، وتمكين الموظفين من استخدام أدوات الذكاء الاصطناعي، وتمويل البرامج لوضع معايير لاستخدام الذكاء الاصطناعي في البحث والتطوير ودمج الذكاء الاصطناعي في الصحة العامة ورعاية المرضى.

وتقول أن أقسام وزارة الصحة والخدمات الإنسانية تعمل بالفعل على الترويج استخدام الذكاء الاصطناعي "لتقديم إرشادات صحية شخصية واعية بالسياق للمرضى من خلال الوصول إلى سجلاتهم الطبية وتفسيرها بشكل آمن في الوقت الفعلي". أعرب البعض في حركة كينيدي "اجعل أمريكا صحية مرة أخرى" عن مخاوفهم بشأن استخدام أدوات الذكاء الاصطناعي لتحليل البيانات الصحية، وقالوا إنهم غير مرتاحين لعمل وزارة الصحة الأمريكية مع شركات التكنولوجيا الكبرى للوصول إلى المعلومات الشخصية للأشخاص.

واجهت وزارة الصحة والخدمات الإنسانية سابقًا انتقادات بسبب تجاوز الحدود القانونية في مشاركتها للبيانات الحساسة عندما سلمت البيانات الصحية الشخصية لمتلقي Medicaid إلى مسؤولي إنفاذ قوانين الهجرة والجمارك.

يتساءل الخبراء عن كيفية ضمان الإدارة لحماية البيانات الطبية الحساسة

قال أورين إتزيوني، خبير الذكاء الاصطناعي الذي أسس منظمة غير ربحية لمحاربة التزييف السياسي العميق، إن حماس وزارة الصحة والخدمات الإنسانية لاستخدام الذكاء الاصطناعي في الرعاية الصحية يستحق الاحتفال، لكنه حذر من أن السرعة لا ينبغي أن تأتي على حساب السلامة.

"تضع استراتيجية وزارة الصحة والخدمات الإنسانية أهدافًا طموحة - البنية التحتية المركزية للبيانات، والنشر السريع لأدوات الذكاء الاصطناعي، والقوى العاملة التي تدعم الذكاء الاصطناعي - لكن الطموح يجلب المخاطر عندما وقال: "التعامل مع البيانات الأكثر حساسية التي يمتلكها الأمريكيون: معلوماتهم الصحية".

وقال إيتزيوني إن دعوة الاستراتيجية إلى "علم المعيار الذهبي"، وتقييمات المخاطر والشفافية في تطوير الذكاء الاصطناعي تبدو علامات إيجابية. لكنه قال إنه يشك في قدرة وزارة الصحة والخدمات الإنسانية على تلبية هذه المعايير تحت قيادة كينيدي، الذي قال إنه غالبًا ما استهزأ بالصرامة والمبادئ العلمية.

وأشار داريل ويست، زميل بارز في مركز الابتكار التكنولوجي التابع لمعهد بروكينغ، إلى أن الوثيقة تعد بتعزيز إدارة المخاطر ولكنها لا تتضمن معلومات مفصلة حول كيفية القيام بذلك.

وقال: "هناك الكثير من الأسئلة التي لم تتم الإجابة عليها حول كيفية التعامل مع المعلومات الطبية الحساسة وطريقة مشاركة البيانات". "هناك ضمانات واضحة معمول بها للسجلات الفردية، ولكن ليس هناك الكثير من الحماية للمعلومات المجمعة التي يتم تحليلها بواسطة أدوات الذكاء الاصطناعي. أود أن أفهم كيف يخطط المسؤولون لتحقيق التوازن بين استخدام المعلومات الطبية لتحسين العمليات مع حماية الخصوصية التي تحمي المعلومات الشخصية للأشخاص. 2025.